Midifan @ ADE 2015 专访:Max Cooper 的 Emergence 音乐视觉盛宴

Max Cooper是一个最近备受关注的艺人,他这次给ADE带来的Emergence音乐视觉秀可以说是ADE最美的一道夜店景观。不但音乐做得好,视觉和内容也很有深度。 长达将近20分钟的Ambient 前奏可以说是对阿姆斯特丹Melkweg这种主流夜店的一种挑战。由于整个演出的音乐和视频都没有向外发行,如果有机会能看到的话一定不要错过!

Max Cooper 是诺丁汉大学计算生物学系的博士毕业生,也是伦敦大学的博士后,主攻基因调控网络进化的建模。大学期间他一直都在做DJ,博士毕业以后他就全身心投入到音乐的创作里。今年在西雅图Decibel音乐节首演的Emergence是与 15个视觉艺术家合作完成的一个故事,这个故事包括不同的章节,而故事是从一个简单的Emergence概念而来的。这个概念从宇宙开始前已经存在,是简单物质经过互动然后变化成复杂个体的一个过程;比如说水分子变成水晶,细菌逐渐变成复杂生物的过程。

以下采访NS=Neosinewave,MC=Max Cooper

NS:能跟我们讲一下你的演出设置?

MC:整个演出主要使用Akai的控制器控制Ableton

然后midi信息会通过MaxforLive(简称M4L)转换成OSC,用iConnect的ethernet连接到VJ软件Resolume触发视频和特效。

所以在Ableton里的音轨有三种类型。

第一种当然是音乐(可以说这个set的设计主要来自Max本身是DJ的背景),第一轨的名称是Glitch,主要是glitch loops;接下来的两轨是Track A和Track B(就等于是两台CD机),整个set也是以这两条音轨为中心设计的。在这两轨里,每首曲子把前奏,主歌,副歌等都已经分类好了,做成不同的cue point。接下来的一轨是Mix,主要是为了给需要的轨道加入少量的压缩。最后一部分的轨道,分类比较细致,以打击乐器为主,比如说Drum,Bass,Percussion等;这些轨道都是从原来的音乐导出的分轨,主要作用是在需要比较Ambient的感觉的时候能随时把打击乐去掉,当然相反也能在必要的时候加强大打击乐的力度。

第二部分的音轨是视觉效果控制,这些轨道的作用主要是使用M4L自带的Max API Param2Param对Resolume中不同层次(layer)的视觉效果参数进行控制。这个小插件能把音乐里使用的不同效果器参数对应连接到VJ软件上的效果器上,以达到音乐和图像同步。

当然除了直接的控制,也可以通过图中白色的Dummy Clip对视觉效果进行控制

因此在演出的时候,我不用去考虑视觉部分的内容,这些在前期准备中已经做好了。(现场看到Max使用一个旋钮控制Filter能影响Resolume里面超过二十个的视觉效果参数,同时这些参数会以不同速度,不同变量,以及不同包络曲线进行变化)

最后一部分音轨是简单的midi轨,通过发送信息触发VJ软件里对应的视频片段。

演出里另外一个控制器是iPad,只是用来触发采样,跟launchpad一样,一共64个按键,这64个按键对应的是我自己做的Drum Rack采样音色,都是各种one-shot 音色(当触碰ipad的时候也会有非常炫酷的视觉效果)。这些采样是我平时通过收集老旧唱片里噼里啪啦的声音,户外录音,或者是音色库而来的。为了保持这些音色的统一性,我要做大量的音频剪辑,有的时候会制作一个听起来很混乱的音色并把这个音色录下来,长度可能会在一个小时以上,然后把里面有意思的片段剪切出来;有时候我也会通过Ableton的Resampling功能导出音频,再通过效果器进行处理,再导出,再处理,并多次重复这个过程,为了达到想要的音色。

NS:你是怎么跟视觉艺术家合作的?

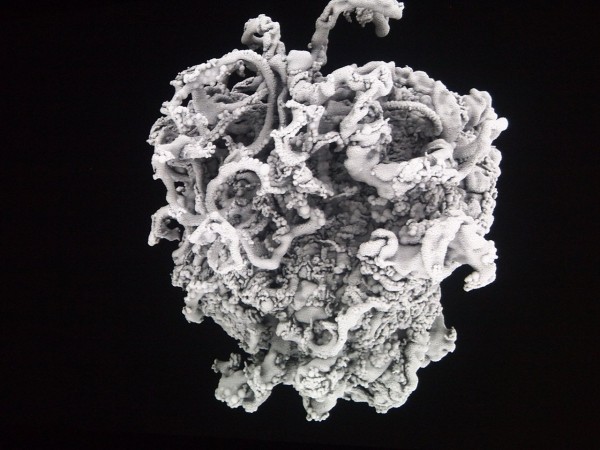

MC:每个视觉艺术家都有他们自己的特点和长处。有的擅长手绘,有的擅长3D,有的擅长设计自己的系统让图像与音乐的紧密的同步。我只要找能准确做出跟我想象的画面一样的人就行了。我可以说是导演,最有意思的创意部分都是我在做,他们要完成的部分其实很难。 实际上这里面有2个人是数学家,他们的视觉设计经验并不是很丰富,做出来的效果也比较粗糙。但是只有他们能完成我提出的要求,因为视觉的设计是跟数学的问题相关的。

这是使用Matlab软件做成的图像

NS:是去年你在ADE做的4Dsound演出经历给你灵感去做这个演出吗?(4DSound是一个拥有57个音箱的虚拟声场空间,每根柱子有3个音箱,地底下还有9个低音音箱,可以通过iPad和Ableton对声音在空间里的声音进行控制,Midifan 之前有过详细的报道介绍:http://www.midifan.com/modulenews-detailview-18070.htm)

MC:Emergence这个概念我10多年前就有了,是使用4Dsound的经历鼓励我去使用不同的设备系统进行演出。

NS:你的音乐里有很多Glitch的元素,你对这种风格的音乐有什么看法?

MC:Glitch音乐已经有挺长的时间了,但是现在Glitch的复杂程度由于电脑处理能力的提升,已经远高于以前了。像Rob Clouth(aka Vaetxh)的音乐,做得很细致,7年前的电脑处理能力远远做不到这样的效果。现在很多人都在开发新的的软件,使用新的技术去探索Glitch的可能性。

NS:我知道你之前做音乐除了电脑以外没有任何其他的设备,最近还是这样吗?

MC:我去年去录音室把我做的一些音乐经过吉他音箱重新处理了一遍,得到了很自然的失真效果;自那以后我就买了很多新的吉他效果器。我现在最喜欢的合成器是Moog Sub 37和Dave Smith的Prophet。我也很常用Ableton的Operator,Absynth和Obscurium等;立体声话筒(Binaural Mics)我也常会用到。

NS:是因为使用了立体声话筒让你的音乐听起来特别宽广的?

MC:其实我音乐制作的过程中使用了很多Psychoacoustics(心理声学)的技巧 。

NS: 能举一些例子吗?

MC: 我刚刚提到的使用立体声话筒录音就是其中一种方式。还有其他的方法,比如说使用Empty Room System公司的Dim D软件;使用效果器让左右声道之间有一个几十毫秒的延迟;模仿立体声录音的效果;相位效果器等等这些各种各样的方式让处理过的声音听起来更宽广(心理声学可以说是一种用来欺骗大脑的一种手段),经过这样处理的音频再经过混响效果器(尤其是卷积混响),就更能强化音频的空间感了。

本文采访者胡岩鹏(a.k.a Neosinewave) 就读于荷兰,本科主修爵士钢琴,研究生专攻媒体类作曲和声音设计,演过先锋实验音乐,也做各种电子音乐,喜欢通过实践去了解不同风格音乐的技术和声音特点。

转载文章请注明出自 Midifan.com

-

2015-11-17

宇轩

又涨知识了

宇轩

又涨知识了